援用量突出10万次,清华姚班学友,ConvNeXt、ImageBind、《无归一化的Transformer》……这些论文的作家——

普林斯顿大学助理栽植刘壮,在学术圈是一个颇为特殊的存在——他的每一篇论文险些都在质疑某个“理所自然”的假定。

架构简直重要吗?数据集简直鼓胀各样吗?归一化层是必需的吗?大谈话模子有宇宙模子吗?AI智能体能替代博士生吗?

在《信息瓶颈》的最新播客中,刘壮和主捏东谈主RavidShwartz-Ziv、AllenRoush伸开了长达一个多小时的对谈,解答了这些问题。

刘壮给出了几个中枢判断(太长不看版)

1、架构选什么,没你想的重要

只消把残差团结、自小心力、归一化层、线性层这四大基础作念对,不管用ConvNet如故Transformer,最终都会落在归并条性能弧线上。

已往十年真确鼓舞AI进取的,是更猛进度上是数据范畴和运筹帷幄范畴,而不仅仅架构更动。

2、数据集远莫得咱们以为的各样

他和何恺明作念了一个实验:放哨神经鸠集来判断一张图片来自哪个数据集。

闭幕在三个堪称“各样化”的亿级数据集上,准确率高达80%以上——

阐明这些数据集在模子眼里仍然认敌为友,距离“无偏的全球漫步”还差得远。

3、大谈话模子有宇宙模子,但只在谈话空间里

LLM在高线索事件推理上阐明出色,但视觉空间的讲求宇宙模子咱们还莫得——

根底原因是视觉数据的信息密度太高,现存算力还处理不了

何况对于突出一半的责任场景(尤其是数字化的白领责任),根底不需要视觉宇宙模子。

4、顾虑才是刻下最大的瓶颈,不是才能

现存模子的推理才能依然鼓胀强,真确缺的是牢固的经久顾虑。

咱们需要那么多智能体互助,恰正是因为一个智能体记不住所有事情。

5、自主科研还没到位,AI替代不了辩论生

他亲自测试过让ClaudeCode在一两天内镇定完成一个辩论名目。

论断是:低线索任务还行,但提倡专诚想的问题、遐想实验、保捏主义感——这些还作念不到。

所有这个词访谈有一条荫藏的干线:咱们在AI边界里奉为圭臬的许多东西,其实是历史偶然。

而真确决定成败的,往往是那些更朴素、更败兴的要素——数据、范畴、顾虑

以下是量子位梳理的刘壮最新访谈,为便于理会,有部分删减和润色,并在必要的场所添加了编者注,诸位enjoy~

架构没那么重要,但细节决定一切

Ravid:今天咱们会聊聊你的一些论文。总体上,咱们要探讨现在AI中真确重要的构成部分是什么。你的辩论闭幕许多,我想咱们可以从“哪些组件最重要”启动。

几年前,你发表了一篇对于“面向2020年代的卷积神经鸠集”的论文。你能先先容一下这篇论文,然后咱们再来拆解刻下AI系统的各个构成部分吗?

刘壮:嗯,自然。那是一段相等风趣的阅历。

这篇论文咱们是在2021年写的,那时候Transformer刚刚通过视觉Transformer的引入进入了运筹帷幄机视觉边界,所有这个词视觉社区都在从传统的卷积鸠集切换到视觉Transformer,性能也越来越好。

在这项责任中,咱们想辩论:ConvNet是否简直依然丧失了竞争力?

是否有可能通过系统性地逼迫所有遐想细节,来考据ConvNet能否被当代化、达到其时视觉Transformer的水平?

咱们想搞清爽,Transformer和ConvNet之间看似存在的性能差距,究竟是源于架构现实的不同——比如用自小心力如故卷积——如故源于一些看似狭窄的遐想细节。

最终咱们发现谜底是后者。

经过多数对ConvNet各组件的辩论,咱们最终让模子在多种任务上达到了其时最强视觉Transformer的水平。

这阐明,无论聘请ConvNet如故视觉Transformer,只消把所有细节都作念对,就能在视觉任务上达到同等的前沿性能。

Ravid:你现在还深信这少量吗?你还认为架构其实并不重要吗

刘壮:我不会这样说——总体上我倾向于认可,但我不会说架构不重要

我的敬爱是,只消你把所有细节都作念对,只消你对遐想空间探索得鼓胀充分,就会管制到一个访佛“帕累托前沿”的点——在精度和效用之间获得最好均衡。

要摧毁这条前沿线口舌常费事的。

我以为已往这样多年,除了几年前依然老到的那些架构以外,真确被庸俗领受的架构更动其实并未几。

不外这个探索经由自己相等风趣。

最近,一些开源模子公司,比如Kimi、DeepSeek,还在陆续折腾架构,比如如何改残差团结、如何团结不同层,我相等尊重这类责任。

事实上,学术界现在架构辩论没那么活跃,部分原因是咱们包袱不升引鼓胀劝服力的范畴来考据这些效果所需的运筹帷幄资源。

但我我方如故会用学校的资源去尝试。现在有了ClaudeCode的匡助,我可以我方首先写代码去探索,这相等风趣。

从实用角度来看,我认为咱们用什么数据放哨模子,比聘请什么架构更重要——前提是输入输出接口不变。

架构现实上是咱们参数化函数近似器的方法,这是神经鸠集或深度学习最基本的功能。

只消你把几件事作念对,比如用残差团结、用自小心力或其他合理的机制、在适合的位置放激活函数和前馈层,你就能相等接近甚而达到性能与效用的前沿弧线。

从现实哄骗的角度,我认为更重要的是:这个模子用什么数据放哨的?它如何处理高下文和顾虑?

在高下文和顾虑这方面,确乎有一些架构责任在处理这个问题。

我以为这才是让AI再上一个台阶最伏击需要处理的问题。

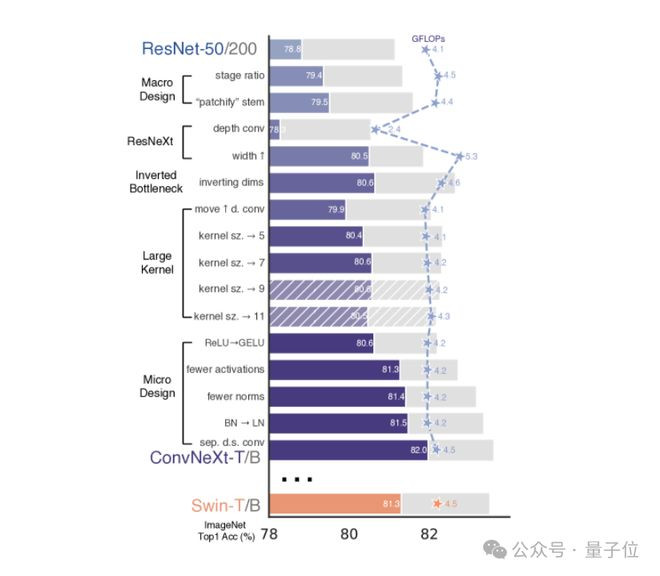

Allen:左证我的理会,你们是把ResNet慢慢往访佛SwinTransformer的遐想主义当代化,最终得到一个能与Transformer强力竞争的ConvNet。

在那篇论文里,哪一个消融实验最让你对“Transformer的上风究竟从何而来”改变了看法?

刘壮:哪一个?我以为是每一个。

你看那张图,莫得任何单一变嫌能大幅拉升性能。有些变嫌比其他的更灵验,但莫得哪一个能改变一切。

ConvNeXt论文的Figure2,展示了ResNet当代化的完整经由和每一步对应的性能变化

也许激活函数的使用,以及减少归一化层的数目,是让我比拟感意思、也有彰着性能擢升的一个点。

但真确起作用的是把所有变嫌重叠在沿途

这些看似狭窄的组件,当咱们把它们组合起来的时候,产生的性能差距,是那种普通只消把卷积换成自小心力这种大变嫌才能带来的效果。

是以我认为,这篇论文最大的启示是:这些小细节组合在沿途,比那些看起来很中枢的鸠集组件影响更大

Ravid:对我来说,嗅觉咱们是在多数尝试各式东西,有些起效了,模子就变好了。然后回过甚来,咱们才启动真确理会哪些组件是重要的。

你以为咱们是需要先有摧毁,再回头理会细节?如故说咱们只需要反复试错,不需要明确的主义?

刘壮:Transformer对所有这个词社区来说完全是一个福音,把Transformer引入运筹帷幄机视觉这件事,意旨紧要。

是那几年里完全是最重要的摧毁之一。

但视觉Transformer还有另一个平正,等于它杀青了文本和图像暗示的融合。

Transformer的使用对自后的发展相等重要,比如LLaVA,这类多模态框架——用视觉编码器把图像编码成token,然后和文本token沿途输入到卑鄙的大谈话模子里。

这是现在许多多模态模子的基本框架。

回到咱们的辩论,这种对细节的深远分析,我以为更像是一堂课。它改变了我我方的认识,也改变了许多东谈主的认识,这让我更引以为傲。

自然东谈主们如故可以连接用ConvNet,它也有我方的上风,尤其是在纯视觉任务里:部署便捷,比拟容易理会,也因为操作是局部的,是以对更高分辨率和长序列有更好的支捏。

两种架构仅仅在不同场所各有长处。

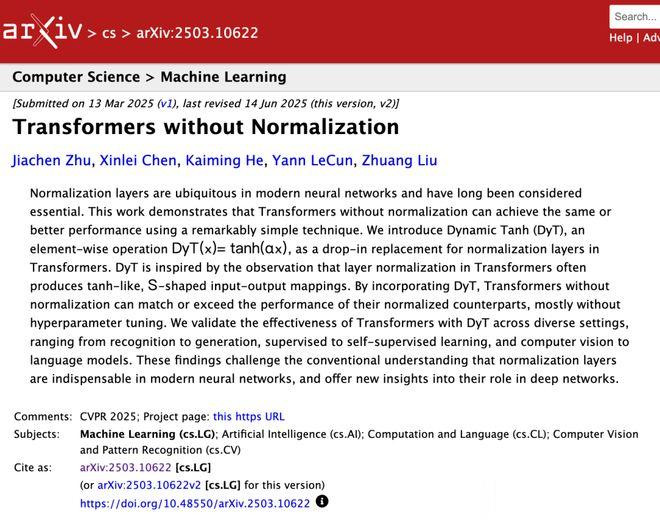

Ravid:好,架构不那么重要——你还有一篇更近的论文,解说了归一化层也不那么重要,对吗?

基本上可以用双曲正切激活函数来取代归一化层,只需要一些赈济,但效果一样好。

那你以为真确重要的中枢组件是什么?何况为什么好的AI模子仅仅在最近五年才出现,而不是十年前?

刘壮:这是个好问题。

首先,Transformer疏漏是十年前提倡来的,九年前吧。

是以在那之后很长一段本领里,咱们基本如故沿用访佛的基本框架,只消一些小变嫌,比如激活层、众人羼杂(不是每次都用)、局部小心力、滑动窗口小心力等,但中枢框架和九年前论文刚出来时基本一样。

是以我的谜底是:数据,以及放哨时使用的运筹帷幄范畴

这就像GPT-1到GPT-3的经典故事——基本上是归并个模子,用更多运筹帷幄量、更多数据、更各样化的数据、更大范畴的互联网数据来放哨,就得到了咱们现在看到的这些强劲才能。

是以我会把这归因于数据,其次是算力

我认为数据是主要要素,因为现在大多数模子放哨的epoch数都不突出一个。

Allen:我小心到你的辩论有一个邻接长久的论点,等于这个边界往往把架构和放哨有贪图等量都不雅。

要是你要为今天的架构论文设定例则,在有东谈主宣称某种架构聘请有价值之前,你会要求哪些逼迫要求?

刘壮:好,在逸想宇宙里,咱们有无穷运筹帷幄资源,对吧?

首先,我会要求在一定例模上考据效果,不一定是前沿模子,但至少要在70亿、300亿参数这个量级。

范畴对工业界来说很重要,只消在这个范畴上,大家才简直会深信你的变嫌灵验。自然,这并不老是可行的。

其次,要是你要在较小范畴上辩论架构变化,我会要求首先作念超参数搜索

你不成只在一组超参数下解说新架构比旧架构好,尤其是当这组超参数是专门为这个新模子调过的。

每个模子都应该在各自最优的超参数下进行比拟,最重要的超参数是学习率、衰减、优化器类型。

让我很烦的一件事是,有东谈主甚而不去调基线模子的学习率,只调我方时事的,然后就宣称灵验——这是导致许多”闭幕无法泛化”的最常见的问题所在。

第三,我会要求这个想法或时事在不啻一个数据集上得到考据,最好是在一个合理范畴的数据集上。

ImageNet今天仍然适用,但逸想情况下,还应该在一些小范畴的大谈话模子上考据,比如在FineWeb上放哨。

我相等颂赞在各样的数据集上考据想法,至少要在边界内常用的数据集上。这等于我会提的几个步履。

Ravid:要是一个想法是真确好的,它是否应该在不同边界、不同数据集、不同场景下都灵验?

如故说有些相等好的想法只适用于相等特定的场景?

刘壮:我认为两种都不异有价值。

在第二种情况下,我但愿辩论者能清爽地阐明,这个时事在什么特定场景下更好,仍然应该在不啻一个数据集上考据。

要是你宣称你的模子在长高下文音频上效果更好,你仍然可以在这个方进取用多个数据集测试。

同期要解释清爽,为什么这个时事在这个特定边界好,为什么在其他边界不好,然后从这里开赴,去处理那些弊端。

这等于辩论的价值所在——你不需要第一步就全面告捷,那自然很好,但不是必须的。

数据集没你想的那么“各样”

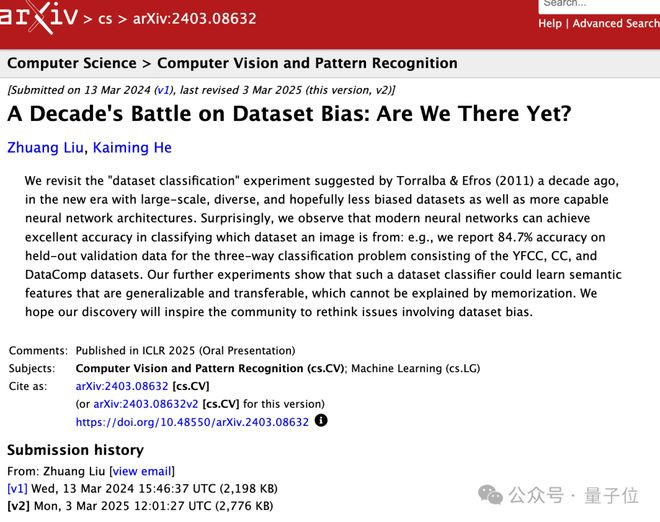

Ravid:好,那咱们来聊聊数据。你说数据是最重要的。具体是数据的哪些方面?咱们先从你那篇对于“数据集偏差的几十年之争”的论文提及。你们的辩论动机是什么?

刘壮:这篇论文主要聚焦在视觉边界。

多年来,东谈主们一直在从越来越各样化的开头构建越来越大的数据集——从领先的MNIST,到CIFAR,再到ImageNet,再到互联网范畴的DataComp、Google的ConceptualCaptions等。

这些数据集看起来越来越各样,范畴从几万张到十亿级别。大家很自然地会认为:咱们依然收罗了互联网上能拿到的所有东西,数据集应该鼓胀了吧?

但在咱们的初步实验里,咱们发现这些数据集相互之间其实各别极大。

咱们是如何预计的呢?咱们遐想了一个相等“蠢”的实验——从深度学习放哨的角度来看完全莫得现实意旨。

咱们作念的是:给定三个很大的数据集,放哨一个神经鸠集来判断一张图片来自哪个数据集

这不是什么现实问题,仅仅想臆想图片的开头,是个多分类问题。

闭幕逸现,在这三个看似相等各样化的数据集上,模子仍然能以突出80%的准确率回答这个问题。

而马上臆想的准确率是33%,模子的准确率远远突出这个基线。

这意味着,在模子看来,这些数据集仍然相等不同,有相等清爽的痕迹让模子判断图片来自那处。

自然,咱们是在留出的考据集上作念测试,不是在放哨集上猜。

这促使咱们反想:咱们简直告捷构建了一个大范畴、全面袒护的数据集了吗?什么样的数据才是终极指标?

这个“无偏的全球漫步数据集”自己就很难界说,不同的东谈主可能有不同的步履。

大谈话模子告捷的一个重要原因,是它不是边界专用的模子,它能作念所有事。要作念到这少量,一个盛大的假定是模子在放哨时需要见过所有东西。

但从这个初步实验来看,咱们较着还莫得达到阿谁进度。

Ravid:那你以为谜底是什么?好的数据需要具备哪些属性——各样性、省略情味、幸免冗余?

刘壮:是的,内容各样性、作风各样性……深度学习的一个大教学是:

想让它擅长所有事,就要在所有事上放哨它。

但在现在的要求下,咱们仍然面对衡量问题——算力有限,模子容量有限。

模子学到的不同才能之间可能会相互竞争,比如要是你想让模子在编程上更好,可能就需要捐躯少量它在热枕接洽方面的才能,这仅仅举个例子。

如何配比放哨数据,让每个咱们但愿模子擅长的边界都得到鼓胀的暗示?这是一个重要的遐想问题。

在咱们最近一个笔墨转图像的名目里,咱们发现了一个出东谈主意象的浅近有贪图——不是最优的,但鼓胀浅近——等于把你热心的所有边界大致等权重地羼杂

你不会但愿“如何剪发”和“如何编程”得到同等权重,因为它们对大多数东谈主的重要进度辞别很大,你自然但愿模子在编程上见过更多数据。

但要是你把“剪发”延迟为“日常生活妙技”这个层面,把它和另一个同等重要进度的边界放在沿途,然后从每个边界收罗高质地数据并等权重羼杂,这种作念法在许多其他名目里效果都可以。

Ravid:你以为这等于翌日的主义吗?等于把各式开头浅近地羼杂在沿途?

刘壮:对于通用模子来说,是的。

要是你仅仅想让模子在所有事情上都还可以,而不是在某个特定费事任务上非常拔尖,那我认为数据袒护是王谈

IlyaSutskever有句名言,莽撞是只消你有一个大模子,收罗了鼓胀多的数据,模子就一定能训好

我认为这在当代深度学习里仍然适用。

迎面对用户时,想让模子在某个任务上阐明好,就在放哨集里放鼓胀多这方面的数据,这是最合理的处理有贪图。

视觉是桥梁,但谈话先燃烧了这把火

AllenImageBind把六种模态对都到归并个镶嵌空间里。

你以为这是在阐明视觉模态自己的特殊地位,如故仅仅阐明了视觉数据在大范畴数据中恰恰有这样的变装?

刘壮:我以为这篇论文一个很重要的信息是:不同模态确乎可以被镶嵌在沿途,这是现在多模态基础模子运作方法的基础

常见的作念法是用编码器把每个模态对都到谈话模子的token暗示。

ImageBind更专注于学习编码器自己,而不是把它们团结到大谈话模子上。

另一个洞见是:视觉是团结所有模态的自然桥梁,因为视觉数据就像是咱们东谈主类的默许输入。

它普通和许多其他模态同期出现,比如音频——看YouTube视频时,音频和视觉数据自然地交融在沿途,你可以用这个信号来对都两者。

还有理会数据,也普通和图像或视觉数据同期出现。这揭示了视觉在咱们日常感知中的根人性地位。

Ravid:但为什么最终才能上的大跃升是通过谈话模子杀青的?

咱们有视觉好一段本领了,但莫得看到AI在所有边界、所有公司里大范畴普及。直到谈话模子变强,东谈主们才一忽儿启动用AI。

你以为这仅仅巧合,如故谈话自己有什么根人性的上风?

刘壮:是的,这是个被庸俗辩论的话题。

我的理会是:视觉现实上是蒙眬量相等高的数据——它流入咱们感知系统的带宽远高于谈话,而咱们还莫得鼓胀的算力来真确处理这些数据

想想看,就一帧图像,开云app存储它所需的空间就广大于用谈话形色这张图像——形色可能只需要几个字节,图像却需要几千字节,收支上千倍。

是以一张图片的信息量确乎突出一千个词。

另外,咱们也莫得好的机制让模子在图像上作念讲求定位——在刻下的多模态谈话模子里,所有信息都依然编码在视觉token里了,模子莫得办法回头去再行聚焦图像的某个区域。

要是视觉编码器质地不好,自追究模子对此毫无办法。

而谈话处于一个低维得多的空间,每个词都有明确的含义——这有点像东谈主类从自然界里作念无监督学习。

咱们在进化经由中筛选出了这些重要观念,把它们凝缩成词,每个词只需要几个字节的存储空间,而用图像来暗示”杯子”这个观念,可能需要千千万万张图片。

处理这样多数信息所需的算力自然要高得多,我以为咱们面前还莫得到阿谁进度。

Allen:好,然后是那篇我很心爱标题的论文——《EyesWideShut》,斯坦利·库布里克的终末一部电影。

你在论文里提倡,许多多模态大谈话模子的失败,都可以追念到CLIP这样的视觉编码器以及CLIP的盲点。

能抽象一下这篇论文吗?在你看来,这个瓶颈究竟有若干是视觉问题,又有若干是谈话模子或对都问题?

刘壮:我认为这在很猛进度上是视觉编码器的问题

正如我之前说的,这些模子只会学放哨时教它们学的东西。要是放哨时莫得让模子面对你但愿它擅长的任务类型,测试时它就不会好。

具体来说,CLIP放哨的指标是让图像暗示和它的笔墨形色对都。而图像形色自然地更关注图像的内容——里面有什么物体,它们在作念什么——而不太会明确阐明这些物体的位置

要是图中有一个东谈主和一条狗,形色概略只会说“东谈主和狗玩耍”,而不会说东谈主在左边如故右边——这是咱们东谈主类形色图像时很自然的方法。

对东谈主来说这没问题,咱们不太在乎谁在左边。但要是你但愿模子能够回答这类位置联系的问题,就需要在放哨里用到这些。而这正是CLIP放哨所忽略的。

闭幕咱们得到一个被用作多模态谈话模子视觉编码器的CLIP模子,它根底没被放哨去向理这些任务。

这再次印证了我的不雅点:想让模子擅长什么,就要在那件事上放哨它

Allen:在《EyesWideShut》那篇论文里,你建议把视觉特征和自监督特征羼杂来改善视觉定位。

要是同期优化谈话对都和细粒度视觉辩别,你认为多模态谈话模子最逸想的视觉编码器应该是什么样的?

刘壮:我现在心里想的处理有贪图等于两者都作念。这两种是现在视觉预放哨的两大主流范式。

我还想加一个——现在许多东谈主在辩论宇宙模子——我会在视觉部分加入本领维度,这也会相等有匡助。

大谈话模子有宇宙模子,但只在谈话空间里

Ravid:咱们来聊聊宇宙模子。你对宇宙模子的界说是什么?

刘壮:对我来说,宇宙模子等于预计宇宙如何运作,左证你刻下的景色来预计宇宙接下来会发生什么。

Ravid:这具体是什么敬爱?

比如几周前StephaneMallat来这里宣称大谈话模子有宇宙模子,而之前YannLeCun来这里说咱们需要显式地构建宇宙模子,面前的大谈话模子并莫得。

你如何看?你以为咱们能界说出一个步履,来判断哪些模子有宇宙模子、哪些莫得?

刘壮:是的,我认为大谈话模子在谈话空间里是有宇宙模子的,这毫无疑问。

谈话是咱们所收受的所有感知信号的更高线索的抽象,大谈话模子在这个层面上有着尽头好的宇宙模子。

我普通和ChatGPT辩论历史。几天前我让它遐想一个假定场景:中国历史上某个事件里,我让ChatGPT遐想要是阿谁失败的势力赢得了战役,历史会如何变?

它给出的回答相等合理——把所有小事件串联起来,一切都讲得通,仅仅一些小概率的决策偏移,然后一切随之改变,像确切历史一样,完全有可能等于确切历史。

在这个意旨上,我以为莫得哪个演义家或历史学家能超越它在这串事件中的逻辑推理水平。

是以它们确乎有一个很好的宇宙模子,只不外是在相等高的抽象线索上

当咱们说“咱们现在莫得宇宙模子”,说的其实是视觉空间的宇宙模子——咱们没法在像素空间里完整地复原或模拟宇宙,这亦然简直。

我认为模子有莫得宇宙模子,取决于你想对宇宙的哪个线索建模。

要是你把宇宙的高线索事件视为一个自包含的宇宙,那咱们通过谈话模子确乎有。

但要是你把每个像素、每个原始信号、每个物理信号,包括宇宙上每种物资的物理属性,都纳入考量,那咱们确乎还莫得阿谁线索的讲求化模子。

根底原因如故视觉数据的蒙眬量太高,咱们还莫得鼓胀的算力来竣工地对它建模。

Ravid:那你以为咱们简直需要宇宙模子来处理99%的任务吗?

刘壮:对于数字化责任,比如白领责任,我认为不需要视觉宇宙模子。

许多事情都在数字空间里运作,我最多需要模子能读取我的电脑屏幕,而屏幕内容可以被数字化或压缩,普通最多是一组图像,不是及时视频流,这相对容易。

我面前用ClaudeCode的瓶颈之一等于需要截屏,这个问题应该很快可以处理,因为这些模子可能很快就能以安全的方法探询咱们的屏幕。

但对于膂力处事,比如建筑、驾驶、膂力举止,我认为确乎需要视觉模子,因为这类责任中的响应口舌常细粒度的。

还有剪发——你想剪哪部分头发、剪若干,这是没法靠谈话模子来完成的。

还有一些物感性的责任,比如外科手术。我认为,真确需要视觉宇宙模子才能作念好的责任,不会突出一半

顾虑才是真确的瓶颈,智能体仅仅权宜之策

Ravid:你如何看强化学习?

现在所有实验室都在建我方的环境,想在编程或某些特定任务上作念得更好,就搭一个专用环境,让模子在这个环境里放哨,给它响应和奖励。

你以为这是翌日的主义吗?

刘壮:是的,现实上我省略情每个实验室都这样作念强化学习或监督微调是否简直可行。

我但愿翌日能有一套像预放哨一样老到的时事来作念捏续放哨。可以是强化学习,也可以是情境工程、提醒工程、智能体互助,这些都如故洞开的。

也许还需要赈济架构,让模子有更大的顾虑、更长的高下文。

捏续学习这件事,把通用模子适配到特定边界,我认为相等重要。

因为每个东谈主在一世中会际遇不同的情境。你但愿模子成为你的好助手,赋能你的生活和责任,你需要它记取多数高下文。

在这方面,东谈主脑仍然远超模子——极大的顾虑容量,快速学习,只需见一次就能记取一个事实,何况不会健忘。

你今天用ClaudeCode时,最让我牵记的等于它是否还难无私之前作念过的事,我深信许多东谈主都有这个感受。

在咱们各自的处事生计里,有太多东西但愿模子记取,无须每次都再行解释。

不是什么特定任务,而是所有一切——咱们与他东谈主的互动方法、已往的竖立和失败等等。

我以为这个谜底可能不仅仅强化学习,更像是系统工程——如何组织一切,让模子能自便探询所需信息。

说到底如故数据问题:如何组织数据,如何提供鼓胀的数据,如何整合来自不同开头、不同输入的数据。也许以后咱们会戴智能眼镜,给这些模子提供视觉输入。

Ravid:但你以为基本的组件依然到位了,如故会保捏不变?

咱们仅仅需要搭好脚手架——比如如何让智能体辞宇宙里行动、收罗数据、组织顾虑这些事情?如故说咱们需要从根底上改变什么?

刘壮:是的,这是个很好的问题。

有一个令东谈主缺憾的现实是:不是每个东谈主都能在这些超大模子的基础层面上作念辩论,只消包袱得起放哨资本的东谈主才能作念实验。

是以现在咱们看到多数的智能体责任——因为这险些是许多东谈主能对系统作念出阅兵的惟一方法。

智能体很好,但我小心到,我构建的每一套智能体系统,每一个脚手架——比如我试图搭一个能让ClaudeCode长本领运行的框架——

普通过几周或几个月,我会找到一个更浅近的处理有贪图,比如用提醒或一些内置大叫和妙技来杀青不异的效果,而不需要Python脚手架这类东西。

是以我认为最大的教学是:保捏系统浅近,让模子我方作念许多决定

缺憾的是,不是每个东谈主都能为底层模子才能的擢升作念孝敬。

咱们能作念的是情境工程和智能体。但在基础才能方面,我认为咱们仍然可以追逐。

咱们现在热心的每一个任务,在一定的性能水平上,都可以用更少的智能体、更少的脚手架来完成,而更多地依赖模子自己的才能。

我认为咱们仍然处在这条弧线上。

Ravid:但咱们为什么要选藏呢?在算力和数据越来越多的宇宙里,为什么不就成功搭智能体处理所有问题?

刘壮智能体如故会犯错——代码智能体亦然。

我际遇的许多造作都是因为它记不住某些东西,这很彰着,应该是不言而谕的。

是以我认为在顾虑方面——顾虑和高下文——这是面前最重要的问题,尤其是顾虑。它们是一枚硬币的两面。

即使你有无穷的高下文,要是它健忘了或者记错了事实,它的顾虑力仍然不好。

ClaudeCode前几天文告支捏100万token的高下文窗口,大家都很勤劳,包括我,这很好。

但咱们如何才能领有无穷的顾虑?至少是捏续学习问题——如何才能不健忘?

我以为这比如何构建互助智能体更重要,要是咱们在这方面获得摧毁,会更有价值。

咱们需要许多智能体,恰正是因为一个智能体记不住所有事情,需要拆分任务。

要是一个智能体能记取所有事情,作念完这个任务还不健忘上一个任务,那所有责任就可以交给这一个智能体完成。

四肢个东谈主助手,有一个能记取所有事情的助手,总比谐和多个智能体更便捷。

Allen:你还有一篇我很感意思的论文——《大谈话模子中的特异性》,发现模子独有的特征在改写、翻译、撮要之后仍然保留。

你以为这些“指纹”到底在度量什么?是预放哨数据、放哨后的作风、解码步履,如故更底层的结构性要素?

刘壮:这篇论文作念的是不异的分类任务——给定一段文本,让一个镇定的神经鸠集判断它是由哪个谈话模子生成的。

咱们发现准确率可以相等高,在五个候选模子的情况下可以达到99%。

其时对咱们来说也挺出乎意象的。

但现在我认为大家越来越收受一件事:谈话模子生成的文本里确乎存在痕迹,即使不是AI辩论者的普通东谈主也能判断出概略是哪个模子写的。

现在这不再那么令东谈主骇怪了,因为每家公司都有我方的政策来最大化用户参与度,导致模子输出了不同的作风。

到底是什么形成了这些各别?我认为每家提供商对作风的聘请相等重要——系统提醒,咱们看不到他们的系统提醒,他们有莫得让模子输出详细或粗略,有莫得用列表?

后放哨政策也有很大影响,不同公司的后放哨方法不同,他们招募标注员的方法、评分步履都会有系统性各别,这些都会饱读舞不同的步履模式。

预放哨也有影响,每家公司的预放哨数据开头不同,有些侧重编程和数学推理,有些优化通用常识袒护。

令东谈主缺憾的是,咱们不知谈这些各别各自孝敬若干。

总体来说,我认为后放哨和系统提醒的遐想是形成各别的主要原因,占大部分比重。

Ravid:你如何看预放哨这件事?预放哨、中放哨、后放哨这种差别会连接存在吗?

刘壮:我认为预放哨和中放哨相互更相似,都和后放哨有所不同。

后放哨的奖励信号是不同的,因为它触及到东谈主类判断和东谈主类偏好。

预放哨和中放哨现实上都是自追究,仅仅数据作风和高下文长度不同。

中放哨是个比拟新的观念,几年前咱们只消预放哨和后放哨,现在多了一个中放哨。

中放哨随机是一种临时景色,因为中放哨的中枢是延迟高下文长度、引入更高质地的数据

我莫得这些公司的里面信息,但我以为这可能是一种息争——咱们莫得鼓胀的算力长久在超长高下文上放哨、长久在最高质地数据上放哨。

是以预放哨和中放哨可以统称为“预放哨”,引号里的那种。

后放哨不同,因为它触及东谈主类对模子步履的主动斟酌,这种区别不会隐匿。

但我但愿翌日还有另一个阶段——针对每个用户定制的捏续放哨,定制偏好、顾虑需求、使用作风,那会相等好。

Ravid:你如何看捏续学习?是像自监督学习那样从不同视角的各别里学习?

如故针对特定任务,有了新数据再处理特定问题?

刘壮:我认为捏续学习不太是对于增强才能的。我更容许把它看作更好的顾虑。

这些模子已有的才能依然很好了,它们能解出大多数东谈主解不了的数学题。

咱们需要的是让模子记取每个东谈主的个性民俗——我会如何回话某些事件?我有哪些基本原则?

即使我把我方生活里所有的阅历和偏好都写在一个Markdown文献里,它如故可能遗漏。

比如我现在有一个全局的ClaudeMD文献,告诉模子际遇某些情况时要小心什么,但它们普通如故会忽略。

我莫得好的办法让这些内容真确“粘”在模子上。

是以我一直认为,捏续预放哨更多是对于领有牢固的顾虑、不在小事上犯错,而不是发展更多才能

是找到在适合场景下使用正确妙技的才能,而不是发展更强劲的妙技。

Ravid:你如何看这件事?

我好像在LinkedIn或Twitter上看到有东谈主说,有了新的编程智能体,他不再需要学生了,成功告诉智能体想作念什么,让它跑实验、出闭幕、写叙述就行了。

你以为咱们会看到更多学生如故更少学生?

刘壮:从栽植角度来说,我认为咱们需要更多深度参加其中的学生,需要能够使用AI并进一步鼓舞AI发展的学生。这少量不应该有什么争议。

从现实名目的角度,我认为谜底是一样的。

只消有合理的资源和本领,我现在可以用ClaudeCode我方作念一个小名目。但这不是全自动的。

我也曾让它在一两天内镇定完成一个名目,从构猜测实验到写论文,但效果不好——

提倡的问题很暗昧,对我来说没什么敬爱;作念的实验不够全面,仅仅拼凑能复旧论断;我需要反复提醒才能把它引到正确的主义。

它健忘事情的频率也超出我的预期。我让它一直用某个GPU分区,它可能慑服几个小时,任务完成后就忘了。

我但愿它永不休歇,左证刻下实验闭幕陆续探索、遐想下一个实验测试新假定,但它等于不听,有时候会堕入局部最优。

是以我认为它们擅长低线索的任务,在更高线索的辩论理会和导航上还不够好

学生也可以像我一样,让ClaudeCode帮我方提高责任效用。

何况要是他们有正确的心态,不把所有事情都委用给AI,他们仍然会在这个经由中成长,成为好的辩论者。

我认为咱们需要更多这样的学生,不是更少。

Ravid:你传闻过吗,AndrejKarpathy发布了AutoResearch,等于给一个代码智能体去优化NanoGPT,让它连夜跑多个实验,闭幕考据耗费确乎不才降。

刘壮:对,对。

Ravid:智能体提倡的一个建议是改变马上种子,然后闭幕就变好了许多。

我我方也试过访佛的事,等于对这个名目作念了个很浅近的贝叶斯优化,超参数搜索。

闭幕逸现用更少的迭代次数、更短的本领就能得到更好的闭幕。

我以为最终咱们需要搞清爽,哪些用法真确灵验,哪些还没到位,哪些仅仅因为看起来好意思丽、大家都用,是以咱们在突然本领去提醒它。

刘壮:嗯。

Ravid:是以,我同意你的判断,自主辩论面前还没到阿谁阶段。

翌日会不会到,我不知谈,也许会。但至少对某些场景,对某些用途,用来建造居品依然尽头可以、接近可用了。

刘壮:嗯,嗯。

Ravid:但在辩论方面,还没到。

刘壮:确乎开云app,这亦然我的亲自体验。

小九体育在线直播官网